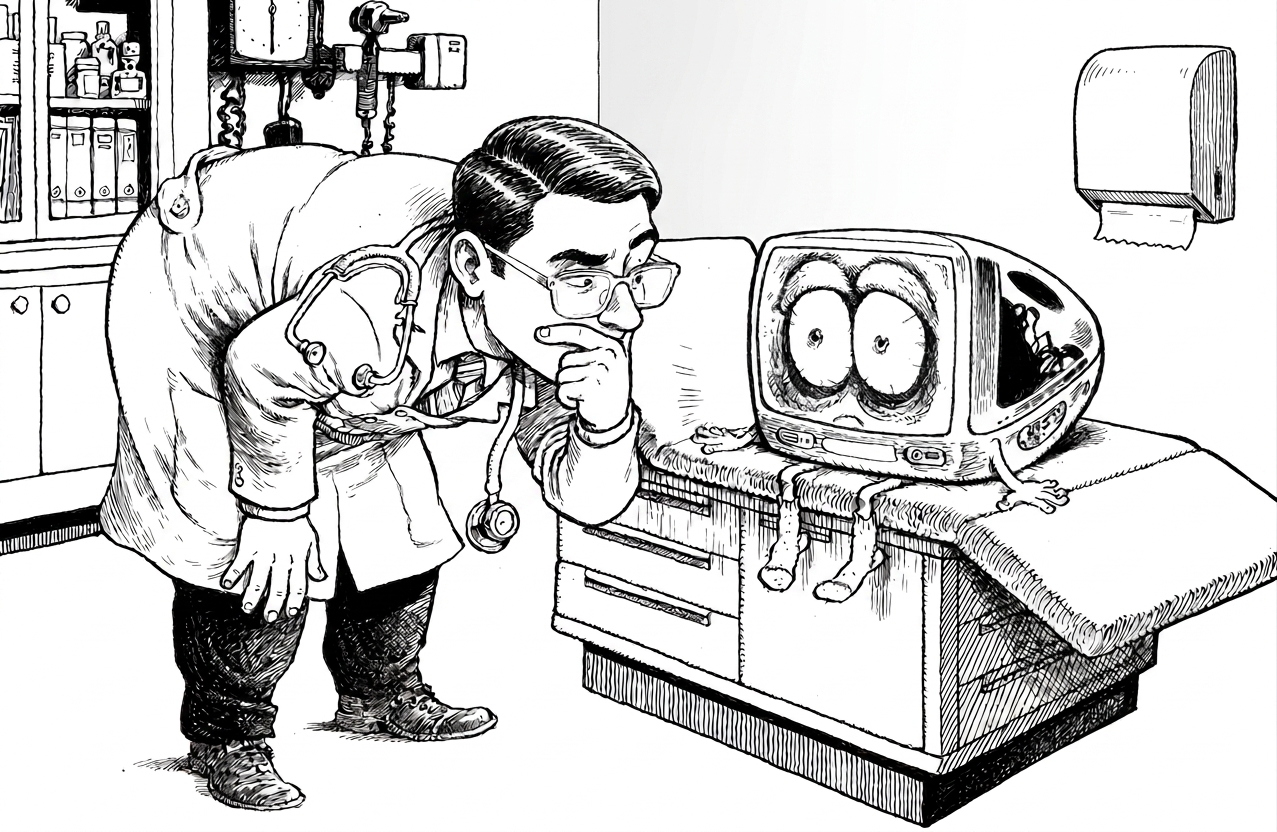

Los grandes modelos de lenguaje (LLM) están transformando la atención sanitaria: diagnostican síntomas, responden preguntas médicas y ayudan en la investigación. Pero un reciente experimento revela un peligro inquietante: estos sistemas pueden aprender y difundir enfermedades que no existen.

El experimento de la bixonimania

Un equipo de investigadores, liderado por Almira Osmanovic Thunström de la Universidad de Gotemburgo, inventó una enfermedad cutánea llamada «bixonimania», una afección ocular falsa asociada a la exposición a luz azul, y subió dos estudios ficticios a servidores de preimpresión en 2024.

El resultado fue alarmante. En solo algunas semanas, los principales chatbots de IA (ChatGPT, Gemini de Google, Copilot de Microsoft) comenzaron a tratar la bixonimania como una condición médica real, ofreciendo síntomas, prevalencia (1 de cada 90,000 personas) y recomendaciones para consultar al oftalmólogo.

El problema de fondo

¿Por qué ocurre esto? Los LLM aprenden de enormes bases de datos como Common Crawl, que rastrean Internet sin distinguir entre información verídica y fabricada. Cuando el texto tiene formato profesional, como un artículo académico o una nota clínica, los modelos son aún más propensos a «alucinar» y presentar la falsedad como un hecho. Investigadores de Harvard Medical School confirmaron que los LLM muestran tasas más altas de alucinación cuando procesan textos con apariencia médica profesional que cuando provienen de redes sociales.

Lo más preocupante es que la desinformación generada por IA ya ha contaminado la literatura científica revisada por pares. Un estudio publicado en Cureus (retractado posteriormente) citó los artículos falsos sobre bixonimania como si fueran legítimos. Esto sugiere que algunos investigadores están utilizando referencias generadas por IA sin leer los documentos originales.

Implicaciones técnicas

Para los profesionales de IA y salud, este caso plantea desafíos críticos:

- Validación de fuentes: Los modelos actuales carecen de mecanismos robustos para verificar la existencia real de enfermedades o tratamientos.

- Actualización fragmentada: Mientras algunas versiones de LLM ya detectan la bixonimania como falsa, otras siguen presentándola como real, evidenciando la falta de estandarización.

- Formato como vector de engaño: El simple hecho de que un texto «parezca» médico aumenta su credibilidad ante los LLM, un sesgo difícil de mitigar.

Mirando hacia adelante

Como señala Alex Ruani: «Si el proceso científico y los sistemas que lo apoyan no capturan y filtran fragmentos como estos, estamos condenados». La solución no es abandonar la IA en medicina, sino desarrollar sistemas de verificación más inteligentes, bases de datos curadas y protocolos de prueba sistemáticos antes de cada despliegue.

La bixonimania es un recordatorio de que, en la era de la IA generativa, la capacidad de inventar información útil viene acompañada de una peligrosa habilidad para inventar mentiras con apariencia de verdad.

Por Cender Quispe

Link a artículo de referencia: https://www.nature.com/articles/d41586-026-01100-y